Créer un système de rendu holographique en temps réel pour des évenements en live

Publié le 2025-08-27

Bonjour, bonjour. Aujourd’hui, nous allons parler de rendu holographique en temps réel. Ce projet a été commandité par la société Coop’art, une coopérative artistique et culturelle en Haute-Loire, basée au Puy en Velay. Nous avons eu pour mission de créer un logiciel permettant de pouvoir projeter des hologrammes en temps réel, durant des spectacles.

Cahier des charges

Ce projet avait pour cahier des charges plusieurs fonctionnalités spécifiques :

- Rendu en temps réel

- Projection holographique

- Capture de mouvements en temps réel

- Capture d’un stream de données de combinaisons de capture de mouvements XSens

- Animation en temps réel de personnages virtuels dans la scène projetée

- Contrôle possible de l’application via le protocole de contrôle d’éclairage Art-Net

- Permet par exemple de programmer des mouvements de caméra en fonction de la musique

- Permet de contrôler les hologrammes avec un panneau de contrôle Art-Net/DMX

- Contrôle possible de l’application de projection via une application compagnon simplifiée

- Utilise le protocole Art-Net en interne

- Exportation de prefabs depuis Unity vers le logiciel de projection

Équipe

Nous étions trois sur le projet :

- Jame Floc’h Le Carour : Programmeur, Designer logiciel

- Cyrielle Bracher : Création d’assets, Design de la démo

- Inès Chtioui : Design de la démo, Performance de la démo (dance)

Technologie

Je me suis occupé de la création logicielle de la suite logicielle de création d’hologrammes qui comportait le gestionnaire de projection holographique, un plugin Unity d’export de prefabs ainsi que l’application de compagnon de contrôle de la projection.

Le logiciel de projection holographique utilise le moteur de jeu Unity pour son rendu. Cela m’a permis d’ajouter les fonctionnalités requises très rapidement. Par exemple, la correction de perspective de projection ou l’importation de Prefabs ou la connexion aux différents protocoles de communication Art-Net/XSens.

Un des premiers tests de performance de projection holographique utilisant un mesh complexe et un rig non humanoïde.

Dans un contexte de spectacle, les spectateurs ne seront pas directement en face de l’écran de projection, il faut donc appliquer une correction de perspective en utilisant une caméra virtuelle placée à la position des observateurs qui projette son point de vue sur une surface plane virtuelle qui représente l’écran réelle.

Le pluginUnity permet d’exporter des prefabs depuis le moteur pour les importer dans le logiciel de projection en runtime. J’ai utilisé le système d’Asset Bundles pour ajouter cette fonctionnalité au moteur.

Voici le workflow d’exportation depuis Unity et l’importation dans le logiciel de projection :

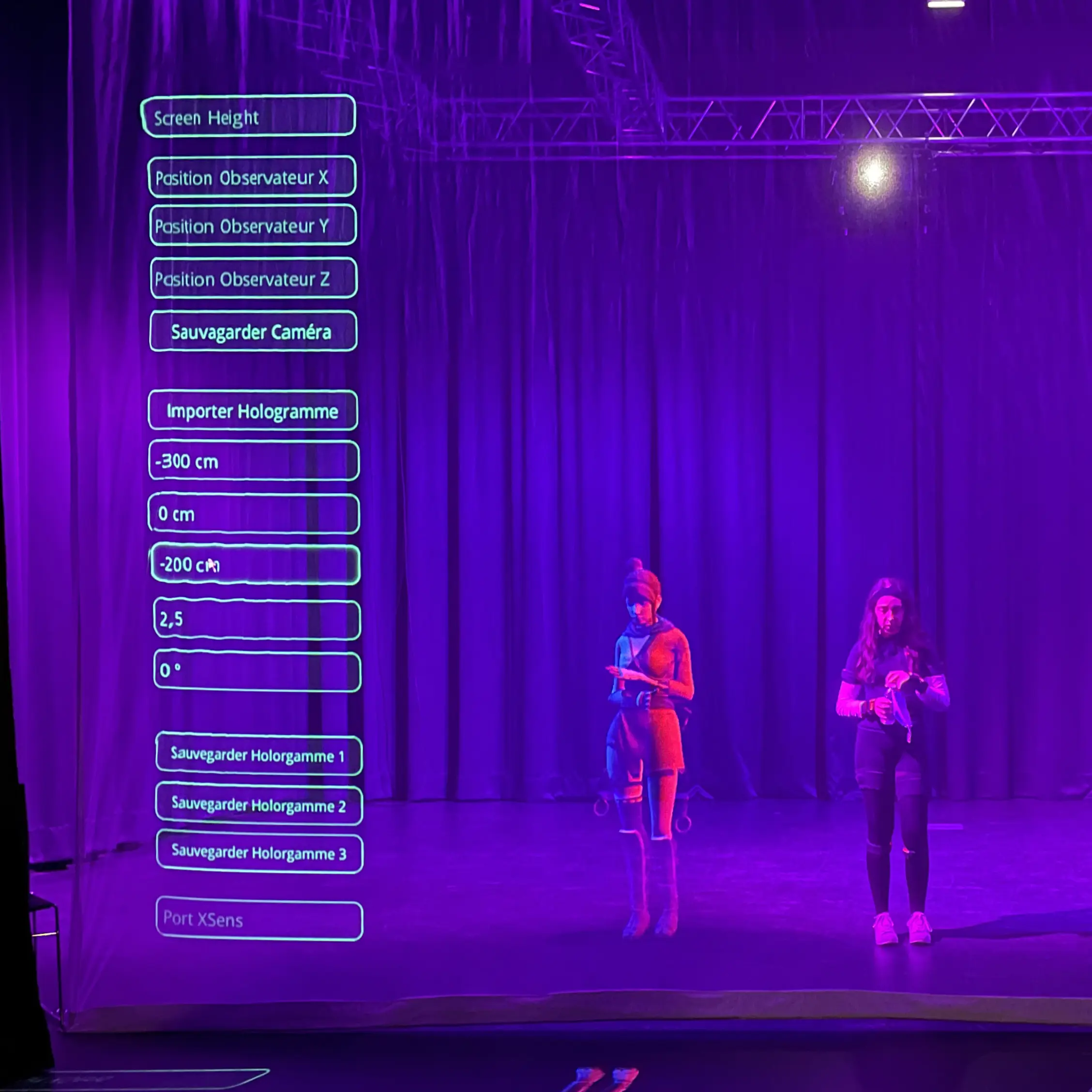

Oui… L’interface est un peu kitch, mais l’idée d’un système holographique ayant une interface à la Matrix me faisait beaucoup rire et plaisait à l’équipe du client. Et, la voir flotter dans le vide lui donnait un certain style futuriste.

L’application compagnon contient une version simplifiée de celle présente dans le logiciel de projection. Elle contient des sliders qui permettent de placer les hologrammes dans l’espace et de déplacer la caméra virtuelle simplement. Elle communique avec le logiciel en créant son propre flux Art-Net.

Démo

Voilà un exemple de la démo réalisée à la fin du projet.

Merci d'avoir lu jusqu'ici, j'espère que cet article a été intéressant à lire, s'il vous à plus n'hésitez pas à le partager ou me le faire savoir ce que vous en pensez !